Chí Tâm

Well-known member

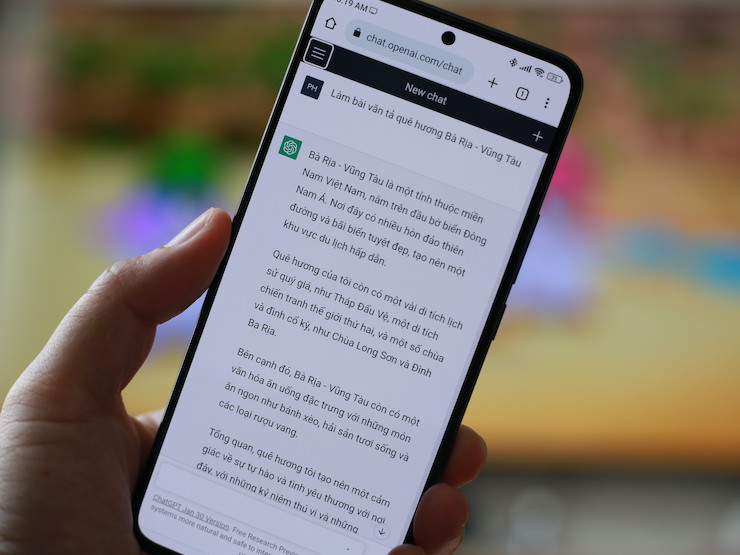

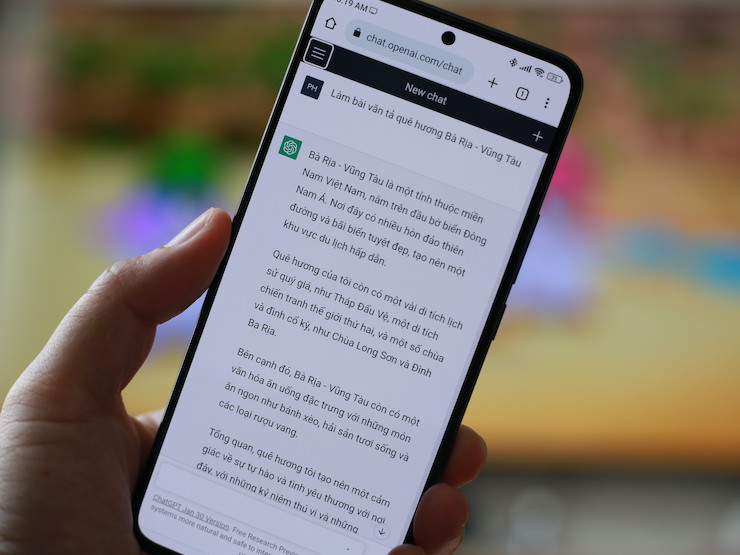

ChatGPT là chatbot ứng dụng trí tuệ nhân tạo (AI) GPT của OpenAI, "làm mưa làm gió" thời gian qua.

ChatGPT là chatbot ứng dụng trí tuệ nhân tạo (AI) "làm mưa làm gió" thời gian qua. Do AI này có khả năng xử lý đáng kinh ngạc tới mức nhiều người gọi là "siêu năng lực" nên "cha đẻ" của nó là OpenAI đã quyết định tạm dừng phát triển trong một khoảng thời gian.

ChatGPT có thể làm thơ, làm văn, thậm chí giải toán và nhiều tính năng siêu việt.

Thông báo do Sam Altman - CEO và đồng sáng lập OpenAI đưa ra. Theo đó, công ty sẽ không huấn luyện GPT-5, công nghệ tiếp nối mô hình ngôn ngữ GPT-4 vừa được ra mắt vào tháng 3/2023. Ngoài ra, OpenAI cũng sẽ đánh giá lại những tác động của GPT-4 hiện tại, vốn đang là nền tảng của ChatGPT.

Sam Altman cho rằng, thách thức lớn nhất trong sự phát triển của trí tuệ nhân tạo đó là rất khó để đo lường và theo dõi tiến độ. Theo ông, nhiều người dùng vẫn cho rằng, các bản cập nhật công nghệ được đánh số sẽ phản ánh những cải tiến nhất định và theo tuyến tính.

Ông khẳng định, đó là một quan niệm sai lầm trong thế giới công nghệ, nơi các con số được gán cho điện thoại hoặc hệ điều hành mới. Thay vì các con số, trọng tâm của các cuộc thảo luận nên tập trung vào khả năng của các nền tảng trí tuệ nhân tạo - những gì AI có thể và không thể làm, cũng như dự đoán về những thay đổi của AI theo thời gian.

Đó là lý do tại sao xác nhận của Altman rằng OpenAI hiện không phát triển GPT-5 sẽ không thể giải quyết lo lắng về sự an toàn của AI.

Trước đó, tỉ phú Elon Musk cùng hàng chục chuyên gia trong lĩnh vực AI đã ký tên vào bức thư ngỏ yêu cầu dừng ngay lập tức việc thử nghiệm liên quan tới các mô hình ngôn ngữ lớn mạnh mẽ hơn GPT-4. Đến nay, đã có hơn 25.000 người ký tên vào bức thư này.

Mục đích của việc này là để các chuyên gia tận dụng khoảng thời gian này, đưa ra một bộ quy tắc giúp các hệ thống AI mạnh mẽ, chỉ nên được phát triển khi chúng ta tin tưởng rằng, tác động của chúng sẽ tích cực và rủi ro của chúng sẽ có thể kiểm soát được hoặc các chính phủ nên can thiệp đưa ra lệnh cấm.

Ông Nguyễn Tử Quảng - CEO Bkav cũng ký tên vào bức như nói trên. Trong một bài đăng trên trang Facebook cá nhân, CEO Bkav giải thích: Hầu hết các chuyên gia AI đều nghĩ rằng phải hàng chục năm nữa mới xuất hiện AI có khả năng như vậy. Do đó mà thế giới chưa có đủ sự chuẩn bị sẵn sàng hành lang pháp chế đảm bảo sự phát triển bền vững, phục vụ nhân loại, thay vì phát sinh những rủi ro không kiểm soát được.

"Có thể ví như năng lượng hạt nhân có thể dùng cho nhà máy phát điện, nhưng cũng có thể dùng chế tạo bom nguyên tử gây nguy cơ hủy diệt", ông Nguyễn Tử Quảng so sánh.

"AI không kiểm soát còn khủng khiếp hơn bom hạt nhân, khi nó giống như một giống loài mới xâm hại, có thể lan truyền qua không gian mạng với tốc độ ánh sáng, mạnh hơn gấp bội so với tốc độ tên lửa mang đầu đạn hạt nhân", ông Quảng viết thêm.

Ông còn lấy ví dụ trong lĩnh vực mà ông đang làm việc: "Ở lĩnh vực anh ninh mạng mà tôi đã trải nghiệm, nhiều vụ lây lan virus qua không gian mạng đã rất khó kiểm soát. Vậy nếu một giống loài ngoại lai xâm hại thay vào đó thì thật không tưởng tượng nổi".

ChatGPT là chatbot ứng dụng trí tuệ nhân tạo (AI) "làm mưa làm gió" thời gian qua. Do AI này có khả năng xử lý đáng kinh ngạc tới mức nhiều người gọi là "siêu năng lực" nên "cha đẻ" của nó là OpenAI đã quyết định tạm dừng phát triển trong một khoảng thời gian.

ChatGPT có thể làm thơ, làm văn, thậm chí giải toán và nhiều tính năng siêu việt.

Thông báo do Sam Altman - CEO và đồng sáng lập OpenAI đưa ra. Theo đó, công ty sẽ không huấn luyện GPT-5, công nghệ tiếp nối mô hình ngôn ngữ GPT-4 vừa được ra mắt vào tháng 3/2023. Ngoài ra, OpenAI cũng sẽ đánh giá lại những tác động của GPT-4 hiện tại, vốn đang là nền tảng của ChatGPT.

Sam Altman cho rằng, thách thức lớn nhất trong sự phát triển của trí tuệ nhân tạo đó là rất khó để đo lường và theo dõi tiến độ. Theo ông, nhiều người dùng vẫn cho rằng, các bản cập nhật công nghệ được đánh số sẽ phản ánh những cải tiến nhất định và theo tuyến tính.

Ông khẳng định, đó là một quan niệm sai lầm trong thế giới công nghệ, nơi các con số được gán cho điện thoại hoặc hệ điều hành mới. Thay vì các con số, trọng tâm của các cuộc thảo luận nên tập trung vào khả năng của các nền tảng trí tuệ nhân tạo - những gì AI có thể và không thể làm, cũng như dự đoán về những thay đổi của AI theo thời gian.

Đó là lý do tại sao xác nhận của Altman rằng OpenAI hiện không phát triển GPT-5 sẽ không thể giải quyết lo lắng về sự an toàn của AI.

Trước đó, tỉ phú Elon Musk cùng hàng chục chuyên gia trong lĩnh vực AI đã ký tên vào bức thư ngỏ yêu cầu dừng ngay lập tức việc thử nghiệm liên quan tới các mô hình ngôn ngữ lớn mạnh mẽ hơn GPT-4. Đến nay, đã có hơn 25.000 người ký tên vào bức thư này.

Mục đích của việc này là để các chuyên gia tận dụng khoảng thời gian này, đưa ra một bộ quy tắc giúp các hệ thống AI mạnh mẽ, chỉ nên được phát triển khi chúng ta tin tưởng rằng, tác động của chúng sẽ tích cực và rủi ro của chúng sẽ có thể kiểm soát được hoặc các chính phủ nên can thiệp đưa ra lệnh cấm.

Ông Nguyễn Tử Quảng - CEO Bkav cũng ký tên vào bức như nói trên. Trong một bài đăng trên trang Facebook cá nhân, CEO Bkav giải thích: Hầu hết các chuyên gia AI đều nghĩ rằng phải hàng chục năm nữa mới xuất hiện AI có khả năng như vậy. Do đó mà thế giới chưa có đủ sự chuẩn bị sẵn sàng hành lang pháp chế đảm bảo sự phát triển bền vững, phục vụ nhân loại, thay vì phát sinh những rủi ro không kiểm soát được.

"Có thể ví như năng lượng hạt nhân có thể dùng cho nhà máy phát điện, nhưng cũng có thể dùng chế tạo bom nguyên tử gây nguy cơ hủy diệt", ông Nguyễn Tử Quảng so sánh.

"AI không kiểm soát còn khủng khiếp hơn bom hạt nhân, khi nó giống như một giống loài mới xâm hại, có thể lan truyền qua không gian mạng với tốc độ ánh sáng, mạnh hơn gấp bội so với tốc độ tên lửa mang đầu đạn hạt nhân", ông Quảng viết thêm.

Ông còn lấy ví dụ trong lĩnh vực mà ông đang làm việc: "Ở lĩnh vực anh ninh mạng mà tôi đã trải nghiệm, nhiều vụ lây lan virus qua không gian mạng đã rất khó kiểm soát. Vậy nếu một giống loài ngoại lai xâm hại thay vào đó thì thật không tưởng tượng nổi".